SERVICES

“デジタルヒューマン”とは

CGで実写と見分けがつかない

人間を作ること

“デジタルヒューマン”というのは、特定の技術があるわけではなくて、ごく平たく言えば「実写と見分けがつかないような人間をCGで作りましょう」ということでしかないんです。

例えば、今この世に存在しない人(亡くなった人など)をCGで置き換えて、生きているように見せましょうというような発想なんです。日本でも松田優作さんが出演した飲料のTVCM(2017)とかやっていましたよね。海外ではオードリー・ヘップバーンが出ているチョコレートのコマーシャル(2013)などが有名です。

そうした事例が出てくる中で、弊社も5年前に“デジタルヒューマン”の研究開発を開始しました。

あの当時は「実写合成なのかな?」って

思っただけだったかも…

“デジタルヒューマン”と言える世の中の事例には、どんなものがありますか?

CGの歴史自体は何十年もありますし、リアルな人間を作ろうとする試みは常にあったわけですが、いわゆる“デジタルヒューマン”と言えるような実写に匹敵するクオリティで、世の中に初めて出てきたものというと、個人的にはブラッド・ピット主演の『ベンジャミン・バトン 数奇な人生』(2008)という映画ではないかと思います。観客はもちろん、“デジタルヒューマン”だと思って観ているわけではないですけれど、どうやってブラット・ピットの80歳の顔を子供の体にくっ付けたのか不思議だったはずですよ。あの当時は「実写合成なのかな?」と思っただけだったかもしれないですけど。

最近では、『ターミネーター:ニュー・フェイト』(2019)でも若い頃のリンダ・ハミルトンとアーノルド・シュワルツネッガーがCGで復活しているし、『マッドマックス 怒りのデス・ロード』(2015)のトム・ハーディがバイクに乗って登場するシーンはスケジュールが合わなくて、首から上だけCGだと聞きました。

ごく最近で強烈だったのは映画『ジェミニマン』(2019)で、主演・ウィル・スミスの若い頃は全部CGだし、Netflixの『アイリッシュマン』のロバート・デ・ニーロとアル・パチーノを若返らせる表現もCGで、それら全てが“デジタルヒューマン”と呼べます。『アイリッシュマン』のカット数に対しての合成処理は莫大だったと思いますよ。

「(ベンジャミン・バトンは)できません」と答えるしかなかった。

それがずっと心に引っかかっていた…

「(ベンジャミン・バトンは)できません」

と答えるしかなかった。

それがずっと心に引っかかっていた…

なぜ、デジタルフロンティアでデジタルヒューマンの研究をやろうと思ったのですか?

きっかけはとあるカメラマンさんの言葉ですね。弊社が佐藤信介監督と『GANTZ』(2011年)の映画を作ったとき、初めての顔合わせで撮影監督の河津太郎さんに「御社のCGでベンジャミン・バトンのようなことはできないの?」なんて言われてしまって(笑)。当然映画は観ていて、ブラッド・ピットが年を取るごとに若返る表現は当時とても気になっていたわけですが、その時は「できません」と答えるしかなかった。それがずっと心に引っかかっていたんです。

そんな出来事があって数年たったあと、研究開発の予算を確保できたので念願の“デジタルヒューマン”プロジェクトをスタートさせた感じです。それが今から5年前くらいのことです。

まずは……亡くなった人の復活だと思いました

まずは……亡くなった人の復活だと思

いました

実際にデジタルフロンティアがチャレンジした“デジタルヒューマン”である、ショートムービー『座頭市0』の勝新太郎さんが作られた流れを教えてください。

まずは、”デジタルヒューマン”でやる意味があるものはなんだろうと考え、それは「亡くなった人の復活」だと思いました。個人的に勝新太郎さんの『座頭市』(1989)に思い入れがあったので、彼を復活させることにしました。

これは結果的に良かったことなのですが、『座頭市』の勝新太郎さんは、髪が短くて、髪の(揺れたり、なびいたりの)シミュレーションのためのR&D(研究開発)が少なくて済んだ。また、座頭市は盲目で白目を剥いているため、目のR&Dもやらなくて済んだ。結果的に、R&Dが最小限だったんです。

実写と見間違うような見た目にするためには、髪は髪、目は目、肌は肌の研究をしなくてはいけなくて、それぞれにとても時間と労力がかかるんですよ。

その後、勝新太郎さんのリアルに作られた顔を、勝さんの体型に似たタイプの俳優さんが動いた体に乗せるのですが、今回の企画は『座頭市』なので、体の部分は芝居より殺陣ができる人を優先に選びました。知っている殺陣師で身長がそこまで高くなく体型がしっかりしている方にお願いしました。実際には勝新太郎さんよりも身長は低いと思いますが、衣装も着物で体型は隠れるので、最優先は殺陣ができることでしたね。

その後、勝新太郎さんのリアルに作られた顔を、勝さんの体型に似たタイプの俳優さんが動いた体に乗せるのですが、今回の企画は『座頭市』なので、体の部分は芝居より殺陣ができる人を優先に選びました。知っている殺陣師で身長がそこまで高くなく体型がしっかりしている方にお願いしました。実際には勝新太郎さんよりも身長は低いと思いますが、衣装も着物で体型は隠れるので、最優先は殺陣ができることでしたね。

肌の状態は動き担当の人とは別の人をスキャンしました。基準にしたのは89年の最後の『座頭市』の映画に出てくる勝新太郎さんの肌感なのですが、それに近い人をインターネットで探したら、大阪のあるボディビルダーの方にたどり着いたんです。スキャナーもその頃は台湾にしかなかったので、その方にわざわざ台湾に来てもらって、カメラが360度に何台もついたライトステージというドーム状の機械で表情や肌の状態を撮りました。

ライトステージは肌の状態を顕微鏡で見たくらい細かい情報が撮れるんです。そのレベルで情報を取らないと実写に見紛うほどのリアルなディティールに近づけるのは難しいのかもしれないです。

LightStageに関する詳しいコラムはこちら

・DF TALK「LightStage解体新書」 ・DF TALK「LightStage 解体新書 Part2」

・DF TALK「LightStage 解体新書 Part2」

ライトステージで肌スキャンしている画像

ライトステージで肌スキャンしている画像

出来上がった『座頭市0』がこちら

5年間“デジタルヒューマン”の研究を

やっている会社は、国内では他にそうそうない

5年間“デジタルヒューマン”の研究を

やっている会社は、国内では他にそう

そうない

デジタルフロンティアでやる“デジタルヒューマン”の技術は他が作るものとどう違いますか?

“デジタルヒューマン”は技術の集合なので、他社と比較してどう違うということはないと思いますが、弊社の強みとしてはこのジャンルに関しての研究年数が長く、ちゃんと実写に見えるクオリティでCGモデルを動かす技術を保有しているということではないでしょうか。

首から上を”デジタルヒューマン”で置き換えた場合を考えてみると、合成した結果がリアルに見えるかどうかは表情の出来にかかっていると思います。静止画であれば肌の質感がそれなりにあり、肌の光の反射をきちんとシミュレートできれば、CG的には実写に近づくと言えるのですが、動画となると話は別です。

人間の表情は千差万別で、表情筋のごく一部の動きによって表す感情がまったく違ってきますから、そこのクオリティが低いととても実写には見えないわけです。

弊社だと顔のパターンの基本を1つ作って、それに対して約80個もの表情パターンを作ります。その中から例えば、「aの表情を30%、bを40%、cを30%」といった具合にかけあわせて、目的の表情を作るわけです。

ですから、元になるパターン数が少ないとディティールが乏しくなり、実写に見えない。表情一つとっても、実写に見えるクオリティにするにはマンパワーや経験値、それを蓄積するだけの研究年数が必要なのです。

デジタルフロンティアで“デジタルヒューマン”をやり始めたのは5年前のことで、5年間もデジタルヒューマンの研究をやっている会社は、国内では他にそうそうないと思います。

「実在する/した人物」と「実在しない人物」

「実在する/した人物」と「実在しない

人物」

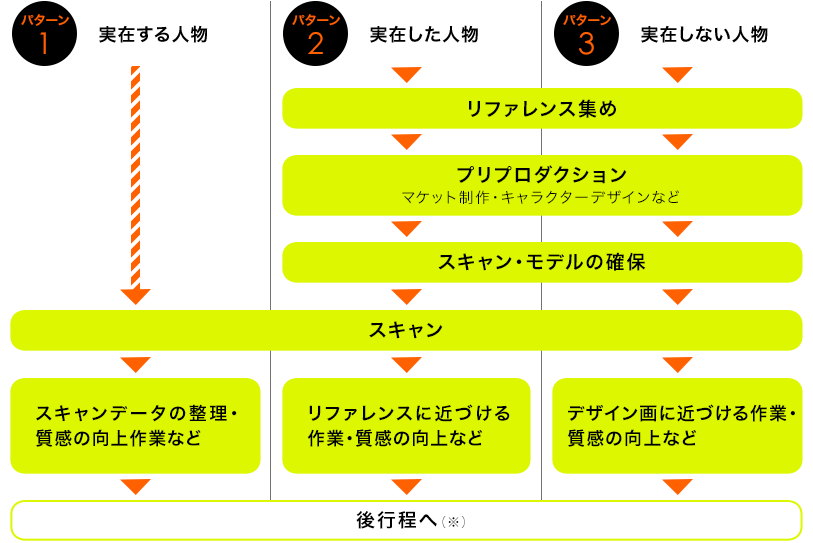

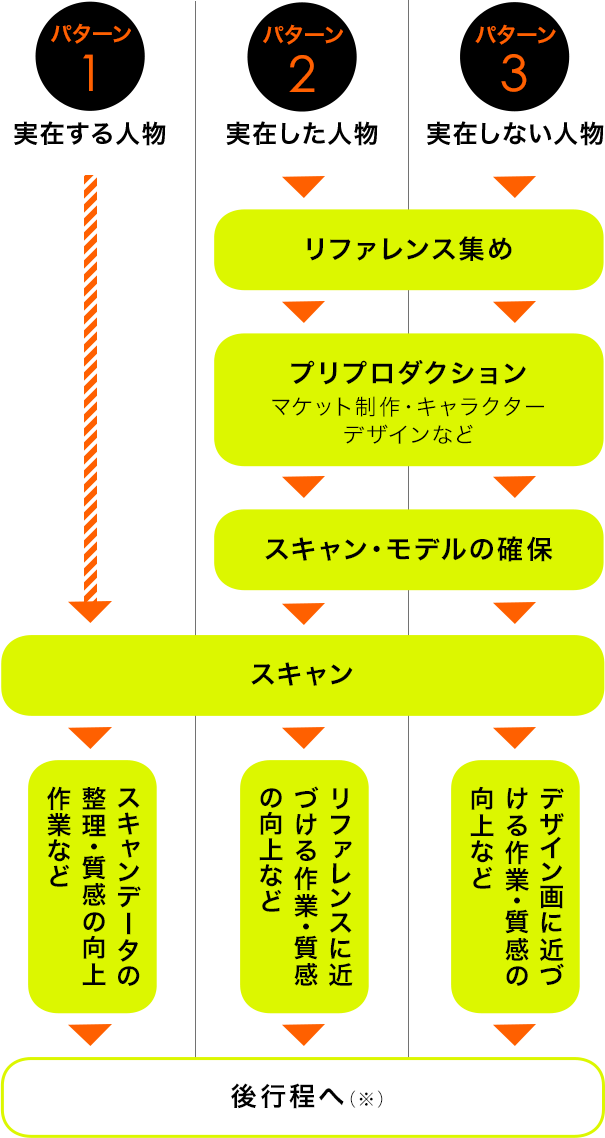

「デジタルヒューマンを使いたい」となったとき、どのような流れで進めることになりますか?

まず制作物には3パターンあると思います。1つ目が、「実在する人物」で、ご健在な本人をそのままCG化するパターン。2つ目は、「実在した人物」つまり故人(ないしは健在だが、昔)のある時点の姿を、資料をもとにCGで復元するパターン。そして3つ目が、「実在しない人物」。これは、0から人物をデザインするパターンです。

実際の事例をもとに、”デジタルヒューマン”の頭部モデルができるまでの工程をご説明しましょう。

パターン

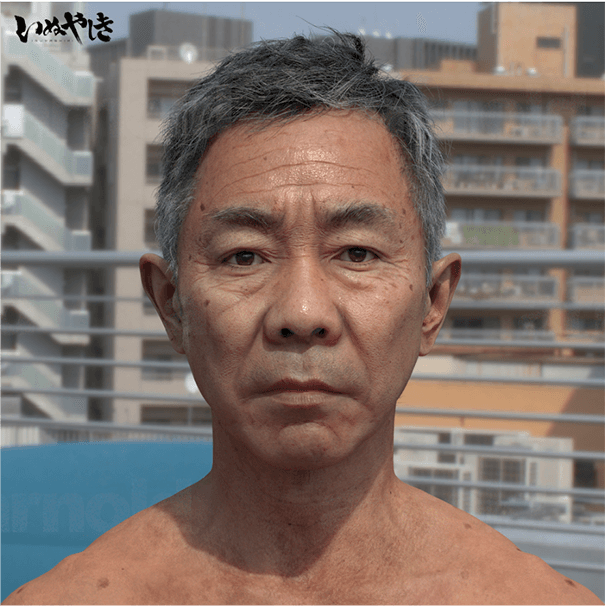

実在する人物 『いぬやしき』の場合

『いぬやしき』(2018)のときの“デジタルヒューマン”は主役の木梨憲武さんが実際にいらっしゃるので、木梨さんご本人が役柄の特殊メイクをした状態でスキャンして質感と形状を撮影しました。

パターン

実在する人物 『座頭市0』の場合

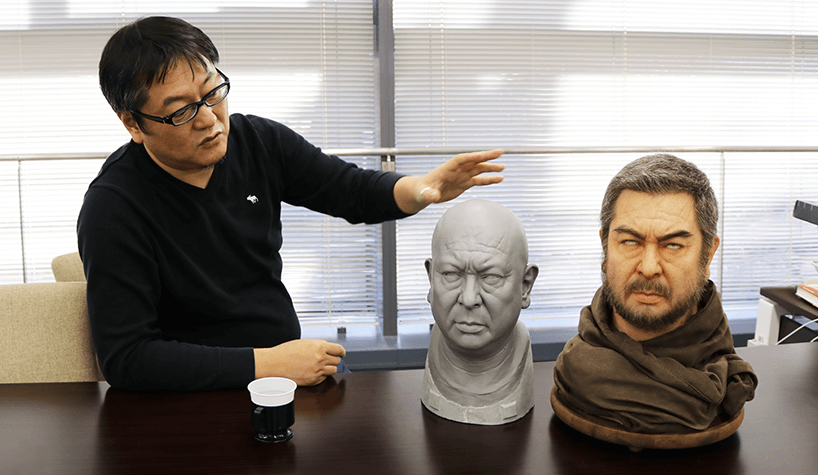

『座頭市0』は、弊社にとってはじめての“デジタルヒューマン”制作でもあったため、クオリティアップのためにはできることをすべてやろうと言うことで、2020年アカデミー賞でメイクアップ&ヘアスタイリング賞を獲ったカズ・ヒロ(辻一弘)さんに、勝新太郎さんの頭部のマケット(シリコンや粘土でつくられる小型の模型)を作ってもらいました。

このマケットと、前段でもお話したように勝新太郎さんに似ている方をスキャンして、CGモデルを制作しました。

このようにモデルの正解となる本人が存在しないため、上記のようなプリプロダクション(CG制作の前工程)や、モデリングの工程に対して、パターン1よりコストがかかることになります。

パターン

実在しない人物の場合

今、社内でオリジナルの女性キャラクターを作るプロジェクトが進行中なのですが、何パターンか合成顔を作って、この顔にしようという流れでやっています。モンタージュ写真みたいなものを作って、好きなキャラクターにして、それを立体化していくという流れです。

これも立体物の正解はないので、形状の調整はデザイナーに委ねられている感じです。

スキャンに関してですが、合成した顔と似たパーツをお持ちの雰囲気が近い人をスタッフがインターネットやSNSなどで見つけて、肌の情報や表情を撮影しました。そのデータをもとにモデリング作業に入っていきます。

上記3パターンの制作工程

(※)頭部の制作が完了したのち、セットアップ、フェイシャルターゲット作成などの工程を経て、実写素材への合成ができる状態になる。

(※)頭部の制作が完了したのち、セットアップ、フェイシャルターゲット作成などの工程を経て、実写素材への合成ができる状態になる。

「人間が何をもって見たものを“人間”だと認識しているのか」とい

う問題の追求です

「人間が何をもって見たものを“人間”

だと認識しているのか」という問題の

追求です

今後どのような展開をしていきたいと思いますか?

“デジタルヒューマン”のオリジナルキャラクターのプロダクションを作りたいです。平行して、アニメーションやレンダリング(計算をしてCGを生成すること)のリアルタイム化などを進め、SNSなどで気軽に“デジタルヒューマン”を登場させたいですね。

これまでの案件のようにプリレンダリングの映像作品や映画などで出番を作ろうと思っても、大掛かりでコストもかかるため、そうそう表に出せる機会もないでしょう。それならば、リアルタイムでサクサク動くものを作ってどんどん世の中に出していくほうが、何倍も訴求力があるのではないでしょうか。また、リアルタイム化する上で、顔だけではなく、服なども含めた体全体をCGにすることができれば、そのキャラクターはメディアを飛び越えてどこにでも出現可能になりますよね。そんな日が年内くらいに来てくれないかなと思っています(笑)。

あと、芸能プロダクションさんにはぜひ考えてみていただきたいのですが、例えば役者さんの若いときをスキャンしておけば、若い頃と現在の本人が共演できたりもするんですよ。勝新太郎さんと、三船敏郎さんと、松田優作さん3人が共演する新しい時代劇が観たいとなれば実現が可能なわけです。予算さえあればできると思います(笑)。僕はそんな興味深いことをしないのはもったいないと思うんですよね。

課題としては音声収録の問題がありますね。それは弊社の制作能力の範疇を超えてしまうので、どこかの会社と組むとか、ボイスチェンジャーなどでアニメのアフレコみたいなことを声優さんにお芝居してもらう流れになるのかな、と思っています。

当然、見た目や芝居のクオリティの向上はCG屋として永遠のテーマであると言えます。「人間が何をもって見たものを“人間”だと認識しているのか」ということは、科学的にもきちんと解明されていないわけで、肌の質感や筋肉の動きなどを研究して、何が違和感なのかを追求していくことは今後も続けていく必要があるでしょう。

企画室メンバー 左から豊嶋、小樋山、遠藤

企画室メンバー 左から豊嶋、小樋山、遠藤